去中心化的GPU网络定位于为运行AI工作负载提供低成本解决方案,而最新的模型训练依然主要在大型数据中心内进行。

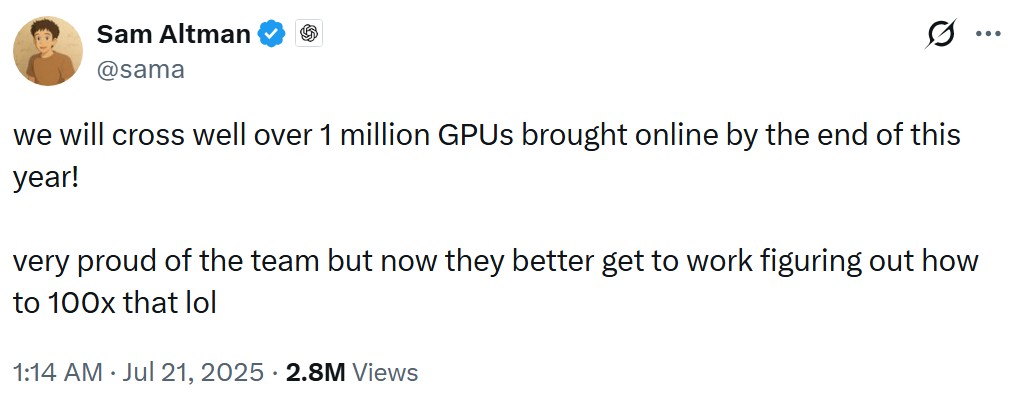

在前沿的AI训练中,构建最大的、最先进的系统需要大量高性能GPU协同作业。

这种级别的协作对去中心化网络来说是一个挑战,因为互联网上的延迟和可靠性无法与集中式数据中心中的硬件相媲美。

大多数生产环境下的AI工作负载不同于大规模模型的训练需求,因此为去中心化的网络提供了更多执行推理任务和其他日常操作的机会。

“我们开始注意到许多开源及其他模型已经足够精简且优化,能够在消费级GPU上高效运行。”Theta Network联合创始人兼首席执行官Mitch Liu表示,“这推动了整个行业向更加高效的开源模型和更具成本效益的处理方式转变。”

从前沿AI训练到日常推理

前沿训练主要由少数超大规模运营商主导,因为大型训练任务的成本和技术难度非常高。最新的AI硬件如Nvidia的Vera Rubin被设计用于优化集成数据中心环境下的性能。

“你可以把前沿AI模型的训练比喻成建造一座摩天大楼。”基础设施公司Ovia Systems(原名为Gaimin)首席执行官Nökkvi Dan Ellidason表示,“在集中式的数据中心里,所有工人都在一个脚手架上,手动传递砖块。”

这种一体化程度使得分布式网络中的松散协作和延迟变化几乎没有空间。

“如果要在去中心化网络中建造同样的摩天大楼,他们必须通过开放互联网将每一块砖邮寄给对方,这效率非常低。”Ellidason补充道。

Meta在训练其Llama 4 AI模型时使用了超过10万台Nvidia H100 GPU组成的集群。OpenAI未披露其用于GPT-5的GPU集群规模,但基础设施负责人Anuj Saharan表示,在GPT-5上线时获得了超过20万枚GPU的支持。

推理是指运行已训练好的模型为用户提供响应。Ellidason称,目前AI市场已经达到了“推理临界点”。虽然在2024年GPU需求主要集中在训练上,但他预计到2026年,推理、智能体和预测型工作负载将推动多达70%的需求。

“这让计算资源从研究成本转变为持续增长的公用事业成本。”Ellidason说道,“因此,在混合架构中实现去中心化计算变得更加可行。”

去中心化GPU网络的实际定位

去中心化的GPU网络更适合可以分割、路由并独立执行的工作负载,这些工作不需要机器之间的持续同步。

“推理是一个巨大的业务领域,并随着每个部署的模型和智能体回路而增长。”去中心化计算平台Fluence联合创始人Evgeny Ponomarev表示,“在这个领域中,成本、弹性和地理分布比完美互联更重要。”

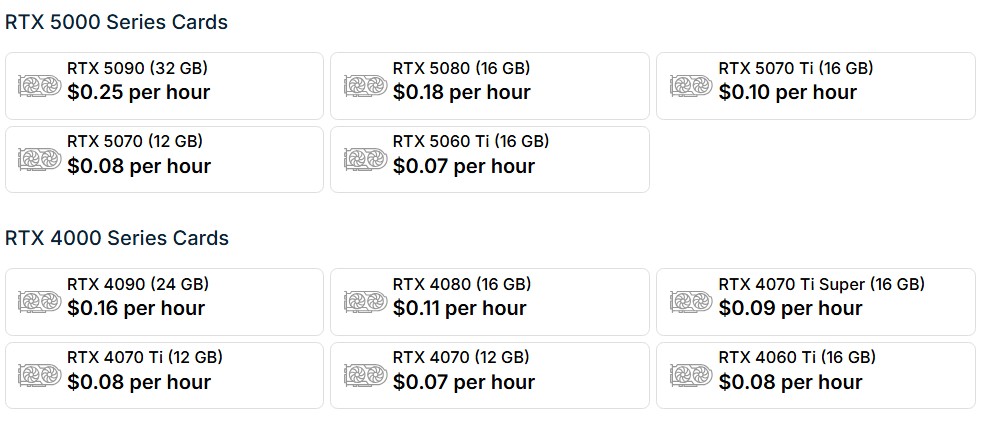

实际上,在消费级环境中运行的去中心化GPU和游戏级GPU更适合追求吞吐量和灵活性的工作负载。

“由于消费级GPU VRAM较低且家庭网络连接环境不适合训练或对延迟敏感的负载,”闲置消费级GPU聚合平台Salad Technologies首席执行官Bob Miles表示,“它们现在更适用于AI药物发现、文本生成图像/视频等成本敏感的应用场景。”

他还指出,在价格和性能方面,消费级GPU具有优势。

去中心化GPU网络同样适合用于数据采集、清洗以及准备训练资料的任务。这类任务通常需要广泛访问互联网,并且可以在没有紧密协调的情况下并行运行。

Miles表示在缺乏大量代理层基础设施的情况下,在超大规模数据中心内高效执行这种类型的工作具有挑战性。

当服务全球用户时,去中心化模型具备地理优势,因为它减少了用户请求到数据中心所需的物理距离和多次网络跳转,从而降低了延迟。

“在去中心化的模式下,GPU分布在全球各地,通常更接近终端用户。因此,从用户到GPU的时延显著降低。”Theta Network的刘明杰表示,“这优于统一将流量路由至集中式数据中心。”

Theta Network正面临两名前员工在2025年12月于洛杉矶地区提起的欺诈及代币操控相关诉讼。目前,该公司否认了这些指控。

AI计算的互补层

前沿AI训练在未来一段时间内仍将保持集中化,但随着越来越多的工作转向推理、智能体和需要松散协作的生产负载,AI计算正逐渐转变为更注重成本效率、地理分布和弹性的模式。

“目前有许多开源模型虽然规模不及ChatGPT,但仍可以在配备RTX 4090或5090等GPU的个人电脑上运行。”Theta技术负责人Jieyi Long表示。

Long指出借助该级别的硬件,用户可以本地运行扩散模型、3D重建模型以及其他有意义的工作负载,这为零售用户提供共享自身GPU资源的机会。

去中心化GPU网络并非取代超大规模运营商的方案,但正在成为AI算力结构中的互补部分。

随着消费级硬件不断升级和开源模型越来越高效,越来越多的AI任务逐渐从集中式数据中心中转移出来,使去中心化的模式在AI生态系统中占据了一席之地。