谷歌前TPU员工创立的新创企业融资34亿人民币,研发新型芯片。

由于性能优于英伟达产品,MatX创业公司备受关注。

公司获得的关注部分归功于卡帕西的推广(没错,他刚刚参与了该公司B轮5亿美元的投资)。

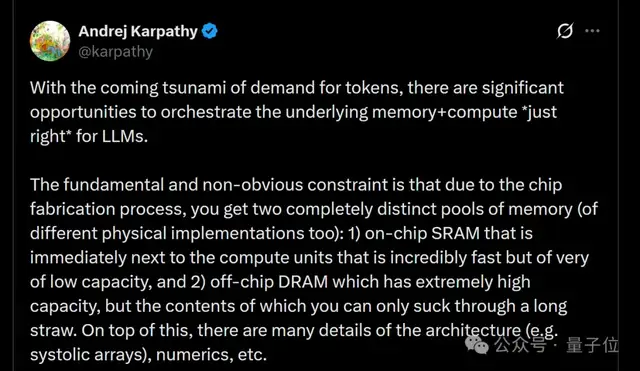

卡帕西指出,在参考英伟达市值的基础上,MatX正致力于解决当今最具挑战性的智力难题,并有望带来高回报。

MatX团队表现出色,有幸成为其中的一员并祝贺公司获得融资!

近年来,AI芯片市场分为两大阵营:

一方以英伟达和谷歌为代表,侧重于高带宽内存(HBM),专注于大规模训练和吞吐量;

另一方则代表了Cerebras Systems,强调片上SRAM(静态随机存储器)以及低延迟,适用于推理场景。

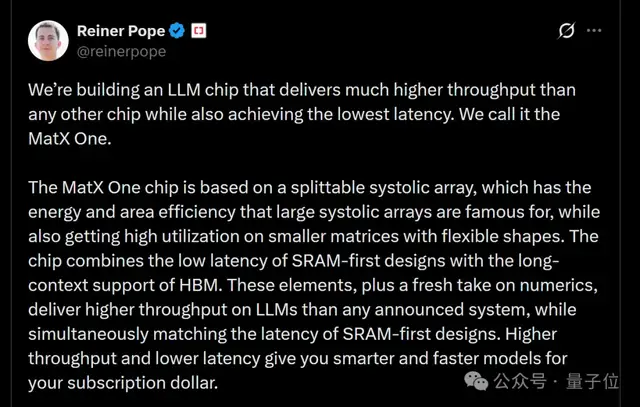

而MatX采取了一种不同策略:它同时追求高带宽内存的优点与片上SRAM的高效性。

在他们的观点中,胜负的关键在于能否在同一颗芯片内实现“训练级吞吐”和“推理级低延迟”,尤其是在处理长上下文、Agent循环等复杂的实际工作流时。

据MatX创始人透露,公司正在开发一款专门为大语言模型设计的芯片——MatX One:

这款芯片在吞吐量方面超越了所有竞争对手,同时保持最低延迟水平。

那么MatX究竟是谁?它能否对英伟达构成威胁呢?

对于MatX的第一印象,人们无法忽视的是谷歌的背景——两位创始人均来自谷歌TPU团队。

公司创始人兼CEO Reiner Pope在加入谷歌时主要负责谷歌地图的部分网页开发,并逐渐成为小主管;

谁是MatX?

后来他参与了Sibyl系统的开发,该系统曾为YouTube、Gmail和Android等服务提供重要支持;直到2017年被更灵活的TensorFlow Extended(TFX)平台取代。

也是从那时起,他对芯片设计产生了兴趣,并加入谷歌内部项目孵化平台“登月工厂”专注于下一代计算架构的设计。

自此以后,他逐渐成为了解模型与硬件协同的关键人物。

自2019年起,他就担任了谷歌机器学习芯片的技术主管兼架构师,参与设计两代ML芯片,并是第二代的主要负责人之一;

他还深度参与PaLM的大规模训练,负责软件和硬件效率优化工作。

Reiner Pope被认为是早期谷歌TPU软件栈的重要成员之一,他不仅擅长开发电路,更懂得如何让模型在大型芯片上运行得更加高效。

公司创始人兼CTO Mike Gunter则有着深厚的“硬件”背景;

加入谷歌前,他曾是一名连续创业者,在无线通信领域有丰富经验,并参与创建了Gossett and Gunter公司,后来被谷歌收购;

在谷歌期间,他负责多种项目,包括无线通信、多天线系统及ASIC设计,甚至成为了谷歌内部第一位逻辑设计师和第一位正式获得报酬写Haskell的工程师。

从2008年开始,他就主导了谷歌的第一个硬件加速项目,并显著提高了计算密集型任务的成本效益;

后来他与Reiner Pope的合作变得更加频繁——共同参与Sibyl系统的开发、几乎同时加入Moonshot Factory以及ML芯片项目的推进工作。

总的来说,Reiner Pope专注于解决模型如何在硬件上高效运行的问题;而Mike Gunter则更早地思考了未来计算形态下芯片的设计方向。

这两个创始人共同展示了软硬结合的力量,表明未来的AI芯片可以同时具备速度和容量的优势。

正在研发中的MatX One芯片无疑承载着这一理念,并有望成为行业内的突破性产品。

如果成功实现更高的吞吐量与更低的延迟,则意味着用户可以在相同预算下训练更大规模的模型、支持更长上下文及复杂的Agent循环,同时获得更快的响应时间。

这正是卡帕西所提及的“设计最优物理基板以最快速度和最低成本获取token”的具体体现。

可见从团队组成到产品理念,MatX已经准备充分,并得到了市场的广泛关注和支持。

根据现有信息,该公司已获得6亿美元公开融资,估值超过数十亿人民币;

2025年3月,公司完成了1亿美元A轮融资,领投方为Spark Capital;

领投方包括Jane Street Group、知名投资人Daniel Gross以及GitHub前CEO Nat Friedman等人。

Reiner Pope总结表示:

经过近一年的发展,MatX团队规模接近百人,在此期间又获得了5亿美元(约34亿元人民币)的B轮融资,投资者阵容进一步扩大。

B轮领投方为Jane Street和Situational Awareness LP;

原有投资方继续跟投,并新增了Dwarkesh Patel、卡帕西以及Stripe联创Patrick Collison及其弟弟等多位投资人;

Reiner Pope再次总结说:

创建MatX的初衷是为了打造最适合大型语言模型的芯片,这意味着我们需要从基础层面进行设计并深刻理解其需求和发展趋势。

为了实现这一目标,我们甚至愿意牺牲小规模模型性能、低容量工作负载和编程便利性。

目前内部测试显示,根据每平方毫米计算性能指标,该芯片已经超越了英伟达即将推出的Rubin Ultra产品;

MatX宣布将与台积电合作,并计划在今年完成全部设计,在2027年开始出货,主要面向少数领先的人工智能实验室。

本次融资将帮助公司预留产能和零部件,以确保一旦准备就绪就能迅速发货。

这一轮融资使我们几乎与那些拥有巨额资金的公司站在了同一起跑线上。

另外值得一提的是,近期被老黄收购的Groq公司与MatX有着相似的发展背景——同样是由谷歌TPU核心成员创立,并试图挑战英伟达芯片霸主地位;

结果老黄以200亿美元将Groq及其团队收入囊中;

没错,就是从零开始。

考虑到MatX创始人兼CTO Mike Gunter也有被谷歌收购的经历,如果MatX确实能做出比英伟达更好的产品,未来可能也会面临类似的挑战。

目标是设计一条全新的、具有竞争力的硬件产品线,融合其他芯片制造商使用的两种截然不同的方法。

MatX试图证明,未来的AI芯片不必在“速度”和“容量”之间痛苦权衡,因为真正的软硬结合,可以让芯片同时拥有两者的优势。按Reiner Pope的话来说就是:

实际上可以在同一个产品中同时做到这两点,而且这样会得到一个更好的产品。

而正在孕育的MatX One,毫无疑问便承载着这一理念。

一旦成功,同时实现更高的吞吐量+更低的延迟便意味着——

在同样的预算下,你可以训练更大的模型、跑更长的上下文、支撑更复杂的Agent循环,同时让每一次用户交互都更快地得到响应。

这正是卡帕西所说的“设计最优物理基板,编排内存与计算,以求最快、最便宜地获取token”的现实注脚。

显而易见,从团队到理念到产品,MatX已经做足了准备。

而对这样一支团队,市场也给予了足够的注目和支持。

明年出货、估值已达数十亿美元

截至目前,这家公司已经获得6亿美元公开融资、估值已达数十亿美元。

MatX官网显示,2025年3月这家公司获得了1亿美元A轮融资,领投方为Anthropic早期投资者Spark Capital。

顶级量化Jane Street Group、知名投资人Daniel Gross(早期投资了Figma/Notion等)、Nat Friedman(GitHub前CEO)、Adam D‘Angelo(Quora联创兼CEO)等均参与投资。

当时Reiner Pope还对MatX做了一个阶段性总结:

两年内,我们在机器学习数值计算、芯片设计和实现、软件和系统设计等方面的所有技术投入都得到了验证,并建立了所有必要的合作伙伴关系,从而开发出了我们的芯片。

凭借这一轮投资,我们现在拥有足够的资金将我们的系统推向市场。

而在快速发展近一年后,规模接近100人的MatX这次又获得了最新5亿美元(约合人民币34亿元)B轮融资,而且阵容还在增加。

具体而言,B轮领投方变成了两家:Jane Street和Situational Awareness LP。

原有投资方Spark Capital、Triatomic Capital、Harpoon Ventures等继续跟投,而且还新增了Dwarkesh Patel、卡帕西、 Stripe联创兼CEO Patrick Collison及其弟弟等人。

Reiner Pope继续总结陈词:

创立MatX的初衷是,我们认为最适合LLM的芯片应该从根本上进行设计,并深刻理解LLM的需求及其发展趋势。为了打造这样一款芯片,我们甚至愿意放弃小模型性能、低容量工作负载,以及编程的便捷性。

可以说,此举已经将人们对MatX One的好奇心拉满了。

内部测试表明,根据每平方毫米的计算性能指标,其芯片性能可以超越英伟达即将推出的Rubin Ultra产品。

据悉MatX将与台积电展开合作,目标是今年完成芯片的全部设计,并于2027年开始出货,主要销售对象为少数几家领先的人工智能实验室。

MatX表示,这笔融资将帮助公司预留产能和零部件,以确保一旦准备就绪就能迅速发货。

这一轮融资让我们几乎与那些拥有巨额资金的公司站在了同一起跑线上。

One More Thing

联想到刚被老黄打包收购的Groq,我们实在想看MatX的未来。

毕竟这两家手上拿的剧本可太一致了——

同是谷歌TPU核心成员创业、同是要挑战英伟达芯片霸主地位。

结果呢,老黄甩出200亿美元就把Groq打包带走了——包括创始人和90%团队员工。

更别说MatX创始人兼CTO Mike Gunter还有被谷歌打包收购的经历……

只能说,如果MatX真做出了比英伟达芯片更好的东西,不说老黄有没有想法,谷歌可能也去争一争也不一定。