相较于单纯的模型升级,此次更新更像是对产品的整合优化。

作者|张勇毅

去年Nano Banana刚火起来时,许多从事平面设计的同行们的第一反应是:“终于不用再用Photoshop去修改那些糟糕的设计了。”

然而当兴奋感消退后,大家才发现一个令人尴尬的问题——虽然模型本身不错,但每次使用前都要专门去找入口、调参数,并且等待时间很长。Nano Banana Pro发布之后,这个问题变得更为严重。

可以说,它更像是偶尔让人惊艳的玩具,而不是随时可用的工具。对于那些真正想用Nano Banana进行创作的人来说,他们需要一个既好用又经济实惠的选择来满足大量需求。

这也是为什么Nano Banana 2备受关注的原因:在2月26日,Google DeepMind发布了Nano Banana 2(官方也称Gemini 3.1 Flash Image)。

实际上,在全球网友已经体验了两个小时之后,谷歌才正式宣布Nano Banana 2的到来。

表面上看像是模型的更新,但更准确地说,是谷歌希望图像生成能够从“需要专门去寻找”变成“随手可用”的创作者工具。

01

谷歌在三个方面向前迈进了一步

首先,在能力层面。Nano Banana 2确实解决了几个长期存在的问题。

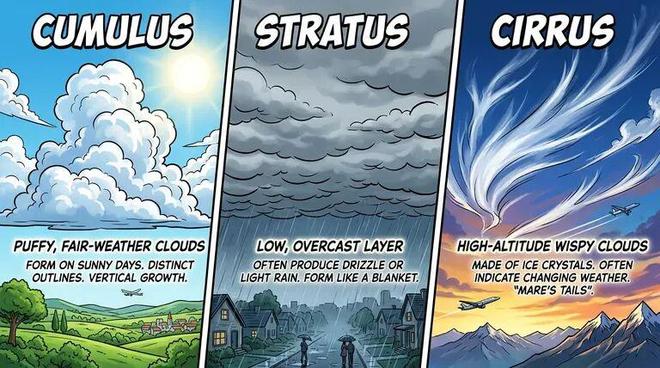

第一:绘画时,模型开始理解当前的时间和事件了。

Google将Gemini的现实世界知识库与实时搜索信息集成到了生成过程中。利用其丰富的全球知识,Nano Banana 2可以通过网络搜索来创建增强视觉效果。

听起来可能有些抽象,简单来说就是——你可以让它绘制一张信息图表,并且它知道数据应该是什么样子;你要求画东京塔时,它不会弄错成埃菲尔铁塔。这对制作信息图、数据可视化等需要“准确”而非“美观”的场景而言,是一项实质性的改进。

第二:图像中的文字变得更清晰了。这听起来像是一个基本问题,但在许多商业场合中,文本渲染比画风重要得多。营销海报、活动主视觉设计、UI原型以及店铺指示牌等地方一旦字体模糊不清,整张图就失去了价值。

在接入Gemini模型以实现网络搜索图像后,用户可以实时获取全球各地的信息来辅助内容生成,比如位置和实时天气数据,用于创建逼真的窗户景观。

如果你从Nano Banana V1就开始使用它的话,可能会记得文字渲染一直是个老大难的问题。

这次更新中,谷歌终于将其作为一个重要项目进行了改进。

Nano Banana 2强调“清晰可读的文本生成”,并且支持图内翻译和本地化功能,这大大缩短了用户获取可用内容的链条。

对于从事海外业务的团队来说,这一特点可能比任何风格上的更新都要实用。谷歌还制作了一个demo来展示它的能力:它可以将广告直接翻译成多种语言以适应国际市场。

第三点是角色和物体的一致性有了显著提升。现在可以在同一工作流程中维持最多5个角色的外貌一致性和14种不同物品的外观统一,分辨率范围从512px到4K,并且用户可以自行选择画幅大小。对于制作分镜、连续故事或系列化物料的人而言,这种能力的价值远超出了“多一种风格”。

诚实地讲,仅看这些功能点的话,Nano Banana 2并没有做出令人惊叹的突破性改进。每一项都是在已有方向上的进一步完善。

然而这次更新真正有意思的地方在于它的应用范围。

02

相比于“画得更好”,Google更关注如何让其服务更加普及

Nano Banana 2被整合到了几乎所有你能想到的谷歌产品中。

在Gemini里,它会取代Fast/Thinking/Pro模式下的Nano Banana Pro。

对于使用Google AI Pro/Ultra订阅服务的人来说,仍然可以通过图片的三点菜单调用Nano Banana Pro来执行更精细的任务——但默认出图能力已经升级了。

在Search中,它进入了AI Mode和Lens,并覆盖141个新增国家和地区以及额外8种语言。在Flow里,它直接成为默认图像模型,对所有用户零credits。而在Google Ads里,则作为创建广告活动时的建议功能。

从整体来看,谷歌的理念很明确:图像生成的关键战场不在模型排行榜上,而在于入口处、工作流中以及用户能够“随手使用”的时刻。

怎么理解这个转变呢?不妨这样比喻:过去的AI绘图工具就像是一个需要专门前往的独立画廊——手艺不错但你需要特别安排时间。现在Google所做的,就是将这样的画廊变为超市里的文具货架——你来买菜的时候顺手就能拿到。

这也解释了为什么Nano Banana 2选择了Flash速度档而非Pro档作为主要推广版本:毕竟在追求规模、速度和分发密度时,在这个阶段极致的质量并不是最重要的考量。

03

对创作者而言,图像模型正在转变为“可配置的渲染引擎”

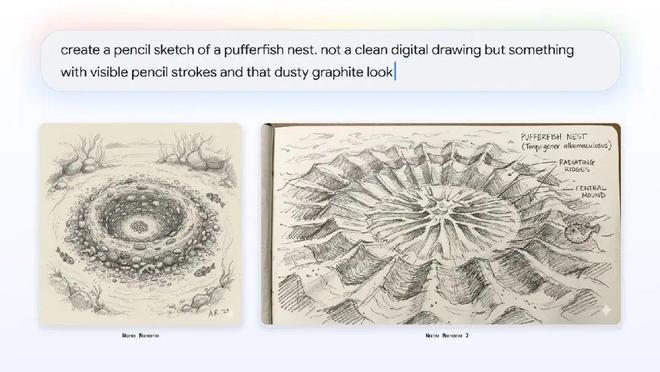

在面向开发者/创作者的版本中,有几点值得注意。

Nano Banana 2新增了4:1、1:4、8:1和1:8等超宽幅画幅比例,并且提供512px分辨率选项。

后者的目标是降低延迟并适应高并发环境。它还提供了“可配置的思考级别”,分为Minimal(默认)和High/Dynamic两种,让开发者可以在速度与推理强度之间进行选择。

如果追求极致效果的话,你当然可以选择生成4K画质的内容;甚至可以根据个人需求、喜好及风格定制壁纸。

当一个图像模型开始提供分辨率选项、画幅参数以及可调的思考级别时,它就不再仅仅是一个“创意工具”,而是一个“渲染引擎”了。这对面向普通用户的模板化出图工具和企业的批量生产系统都会产生直接影响。

以往那些靠“套壳+流程胶水”建立壁垒的图像工具,在未来可能会面临挑战。当底层模型自身就能输出结构化、可预测的结果时,中间层的价值会被削弱。

另一个值得一提的地方是:Google在这次发布中继续强化了生成内容的验证路径——SynthID水印与C2PA Content Credentials相结合。官方透露在Gemini App中的SynthID验证功能已被使用超过2000万次。随着生成式视觉越来越逼真,前置验证机制变得至关重要。

回到最初的问题:图像生成模型的竞争由什么决定?

根据此前Reuters对Nano Banana出圈的报道来看,它确实短时间内为Gemini带来了大量新用户和海量数据生成量。但是“爆款”这种现象偶然性很强。

Nano Banana 2的目标则是将偶然性转变为确定性:更快、更可控,并且更容易被调用;广泛嵌入到各种产品入口中去。它未必是最出色的模型,但它可能是你最先接触到的那个。

在AI产品的竞争中,“首先接触”往往比“最佳”更有意义。

*头图

本文为极客公园原创文章,转载请联系极客君微信 geekparkGO

极客一问

你如何看待?

Sam Altman:训练一个人需要 20 年,不如训练一次 AI 划算。

点赞关注极客公园视频号,