大规模预训练模型虽然表现出色,但在处理“长对话、多轮交互和跨任务”等复杂场景时,依然面临两大挑战:

其一为上下文窗口的限制,在对话持续增长的情况下容易出现信息过载;其二是中间环节的信息丢失问题,即便能容纳所有数据也不一定能有效利用。

因此,引入“外部记忆系统”成为必要:将对话内容储存于长期记忆,并在需要时进行检索。然而这一方案的实际应用却带来高成本的问题:频繁调用大模型执行总结和提取、实时解决冲突以及维护长链路的开销,导致带有记忆功能的智能体难以实现工程化。

为此,研究团队提出了一种名为 LightMem 的轻量级内存系统,旨在平衡效果与效率之间的矛盾。其主要目标是在不降低准确性的前提下,减少 token 和 API 调用次数以及运行时间延迟。

当前的工作强调了在对话场景中引入外部记忆系统的必要性,并展示了一种名为 LightMem 的轻量级且高效的解决方案。

- 论文标题:LightMem: Lightweight and Efficient Memory-Augmented Generation

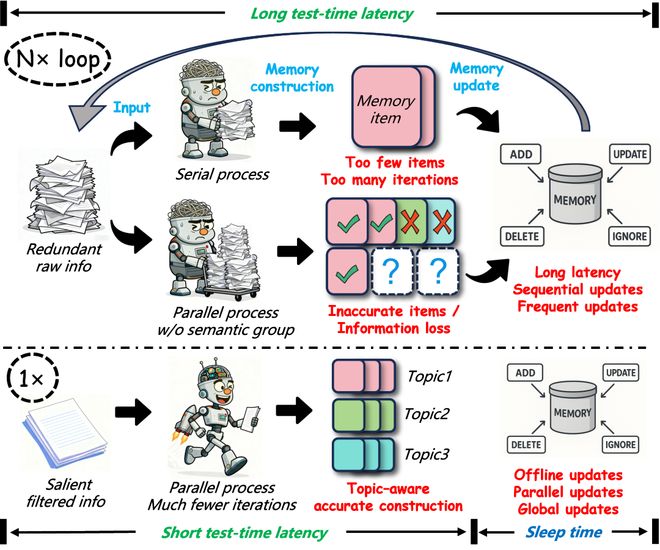

- 该研究探讨为什么现有的记忆系统虽然可用但成本高昂,分析其工作原理并指出了其中存在的问题。主流的记忆模型通常按照对话轮次或会话进行拆分;每一段都要求大语言模型(LLM)生成总结,并将内容存储到向量库中;当新信息出现时,则需要调用 LLM 对知识图谱中的数据进行实时更新。

- 这种做法存在的主要问题是,真实对话场景往往包含大量的冗余信息:如寒暄、重复确认以及不必要的解释。现有系统通常会把这些信息全部纳入处理流程,导致 token 消耗大幅增加,并且可能干扰到模型的上下文学习能力。

此外,无论是用户端还是助手端的对话环节,主题划分过于僵化也会带来问题:过细或过粗的主题划分不仅可能导致总结调用爆炸性增长,还会使信息混杂不清,从而影响准确度;在线更新频繁且复杂,则容易导致延迟增大,并有可能误删重要数据。

LightMem 设计灵感来源于人类记忆机制:并非所有信息都进入长期记忆中,而是存在一套高效分层处理的机制。LightMem 将其核心理念归纳为三部分:“类人记忆” 管道。

具体而言,该系统将记忆功能拆解成三个轻量级组件(分别对应 Light1/Light2/Light3):

第一阶段:感觉记忆(Sensory Memory)

目标是在输入端过滤掉无用信息,并将其压缩为“值得存储”的内容,同时进行主题划分。

第二阶段:短期记忆(Short-Term Memory, STM)

任务是根据主题将对话组织成结构化单元,以减少总结调用次数并防止话题混淆。

第三阶段:长期记忆(Long-Term Memory, LTM)及睡眠更新

目的是把昂贵的内存维护操作从实时推理中分离出来,在离线状态下批量处理去重、合并和修复等任务,从而提高效率。

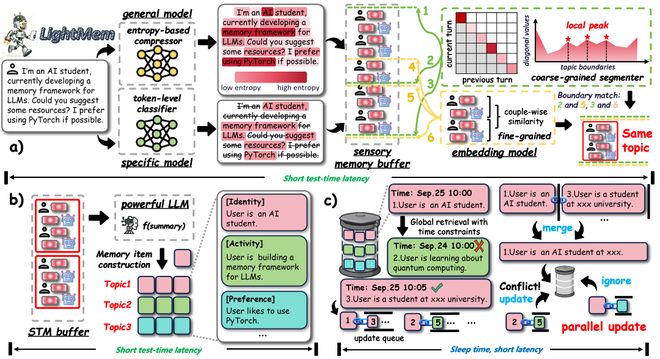

在感觉记忆阶段,LightMem 采用了一种轻量级压缩模型(例如 LLMLingua-2)对原始输入进行预处理:

这一过程保留了语义关键的 token 并过滤掉了大量冗余信息。实验结果显示,在适当的压缩比率下(50% 至 80%),LLM 对于经过压缩后的上下文依然能够准确理解,且不影响整体性能。

关于主题划分,LightMem 提出了一个混合策略来替代传统的固定窗口方法:

这种方式通过注意力信号找到候选的话题边界,并利用相邻片段的语义相似度进行二次确认。最终确定的主题分割点能够有效减少注意力稀释等噪声的影响。

在 STM 阶段,LightMem 接收了划分好的主题单元并按 {topic, turns} 结构送入缓冲区:

当缓冲达到 token 限制时触发 LLM 总结操作,并生成结构化的摘要写入长期记忆。这种方式相比每次轮次都进行总结更加高效且准确。

睡眠更新阶段是 LightMem 的另一个创新点,它通过离线并行处理来减少实时更新的复杂性和延迟:

这种策略不仅降低了在线推理的成本,还避免了可能的数据丢失风险。实验结果表明,在 LongMemEval 数据集上,LightMem 在提高准确率的同时显著降低了计算成本。

总结而言,LightMem 通过优化内存系统的使用方式实现了更好的性能和更低的开销。这项技术对于构建长对话助手、长期在线代理或任何需要高效记忆机制的应用都具有重要意义。

研究者将 LightMem 的方法论及实践经验分享到了 OpenMem 社区,促进了 AI 记忆科学探索与产业实践的全球协作发展。

OpenMem 是一个致力于推动人工智能领域中“记忆”技术标准化、开源化和应用生态建设的国际性社区。它旨在为研究者提供交流平台,并支持企业级及学术级开发者打造高效的记忆系统解决方案。

方继展,浙江大学在读硕士研究生,师从张宁豫副教授,专注于连续学习、大语言模型代理记忆以及大规模预训练模型的知识编辑等领域。他以第一或共同作者身份在 ICLR、ACL 和 ACM MM 等顶级会议上发表了多篇论文,并开源了 LightMem 框架,在 GitHub 上获得了超过 600 星的关注度。他的研究成果受到了 MIT Technology Review 的专访邀请,同时也收到了多家投资机构和大模型厂商的创业交流邀请。

混合主题切分:避免 “按窗口切” 的粗暴做法

仅靠固定窗口 (turn/session) 很难适配开放对话。LightMem 做了一个混合切分策略:

- 用注意力信号找到候选 topic 边界 (局部峰值);

- 再用相邻片段的语义相似度做二次确认;

- 取二者交集作为最终切分点,降低 attention sink、注意力稀释等噪声影响。

Light2:主题感知 STM—— 用 “内容边界” 替代 “窗口边界”

在拿到 topic segments 后,LightMem 把它们以 {topic, turns} 的结构送入 STM buffer。

当 buffer 达到 token 阈值时,才触发一次 LLM 总结,对每个 topic 生成更结构化的 summary,并写入 LTM。

相比 “每一轮都总结一次”,这种做法直接带来两点收益:

- 调用次数降低:总结不再是 N 次,而是按 buffer 触发的更少次数;

- 总结更准确:输入被 topic 约束,不容易 “把 A 主题的细节总结进 B 主题里”。

论文的消融实验也显示:去掉 topic segmentation 会带来明显准确率下降 (GPT/Qwen 都一致)。

Light3:睡眠更新 —— 把开销最高的部分从在线推理中剥离

记忆系统最贵、也最容易出错的一步,往往是 “更新 / 遗忘”。

现有系统经常在 test time 做 hard update:合并、删改、冲突消解都在线执行,延迟高且风险大。

LightMem 的策略是 “两段式更新”:

在线只做 Soft Update:先写入,不纠结

测试时新记忆条目到来,LightMem 直接插入 LTM (带时间戳),不做复杂更新。

这极大降低了在线延迟,并避免 LLM 在实时更新中误判冲突导致信息丢失。

离线做 Parallel Update:每条记忆维护 “可更新队列”

离线阶段 (sleep time) 触发更新:

对每个条目构建一个 update queue (只允许 “新的更新旧的”,即时间戳约束 tj ≥ ti),然后把这些更新操作并行执行。

并行化的关键好处是:

传统在线更新存在顺序依赖 (读写约束) 导致串行累计延迟;而 LightMem 把更新拆成多个独立队列,可以离线并行,整体更快。

结果:不仅更准,而且便宜很多

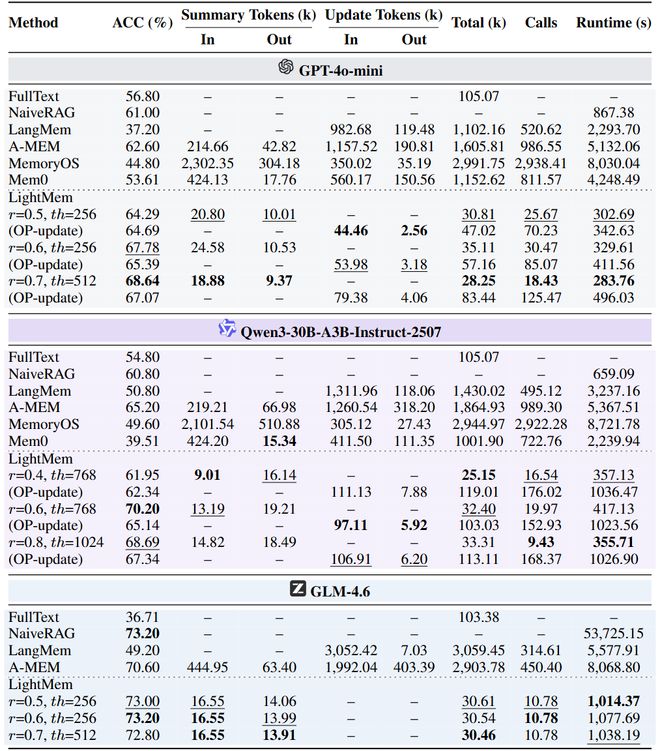

论文在两个长记忆基准上验证了 LightMem 的效果与效率:

- LongMemEval (LongMemEval-S)

- LoCoMo

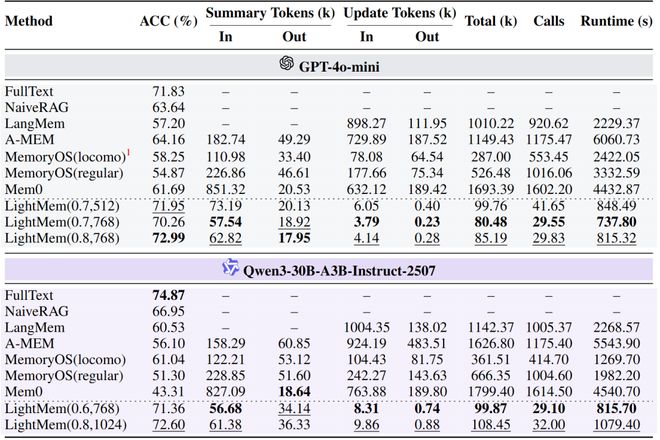

并在不同 backbone 上测试:GPT-4o-mini 、 Qwen3-30B-A3B、GLM4.6。

整体结论非常清晰:LightMem 在准确率上超过基线,同时把成本打下来。

论文报告的代表性结果包括:

- 在 LongMemEval 上,LightMem 相比强基线准确率最高提升约 7.7% / 29.3% (不同设置与 backbone);

- 总 token 消耗降低最高可达 38× / 20.9×,API 调用次数降低最高可达 30× / 55.5×;

- 如果只看在线 test-time 成本,节省幅度更夸张:token 最高 106× / 117×,API 调用最高 159× / 310×。

LightMem 是一套面向真实长交互场景的 “轻量记忆系统” 答案:

它不追求让记忆机制越来越复杂,而是用更接近人类记忆分工的方式,把冗余挡在入口,把维护放到离线,把代价控制在可部署的范围内。

如果你正在做长对话助手、长期在线 agent、或者任何需要 “记忆但又怕贵” 的系统,这篇工作值得细读。

我们将 LightMem 的方法论与工程经验沉淀到 OpenMem 社区 ,推动记忆机制的开放共建与演进。

OpenMem 旨在共建一个 AI 记忆科学探索与产业实践的全球协作社区,让记忆成为 AI 的新 computer layer,促进 Memory Engineering 开源开放,成为 “记忆研究者的家” 与 “记忆技术的标准化基地”,支撑企业级学术级开发者级的记忆应用生态。

作者简介

方继展,浙江大学人工智能硕士在读,师从张宁豫副教授。研究方向为 Continual Learning、LLM/Agent Memory 与大模型知识编辑,聚焦记忆系统、自进化 Agent 与模型可控更新。以第一/共一作者身份在 ICLR、ACL、ACM MM等国际顶级会议发表/接收多篇论文。提出并开源面向 Agent 的轻量化长期记忆框架 LightMem,获得较高社区关注(GitHub 600+ Star),受到MIT technology review邀请专访,并收到国内多家投资机构/大模型厂商的创业交流邀请。