在32倍压缩率下性能超越现有技术25个百分点,破解长文本压缩难题 | ICLR 2026

面对高压缩率时,为什么现有的上下文压缩方法会出现性能骤降的现象?当模型将32K长度的文档压缩至1K时,为何会表现出明显的性能下降?

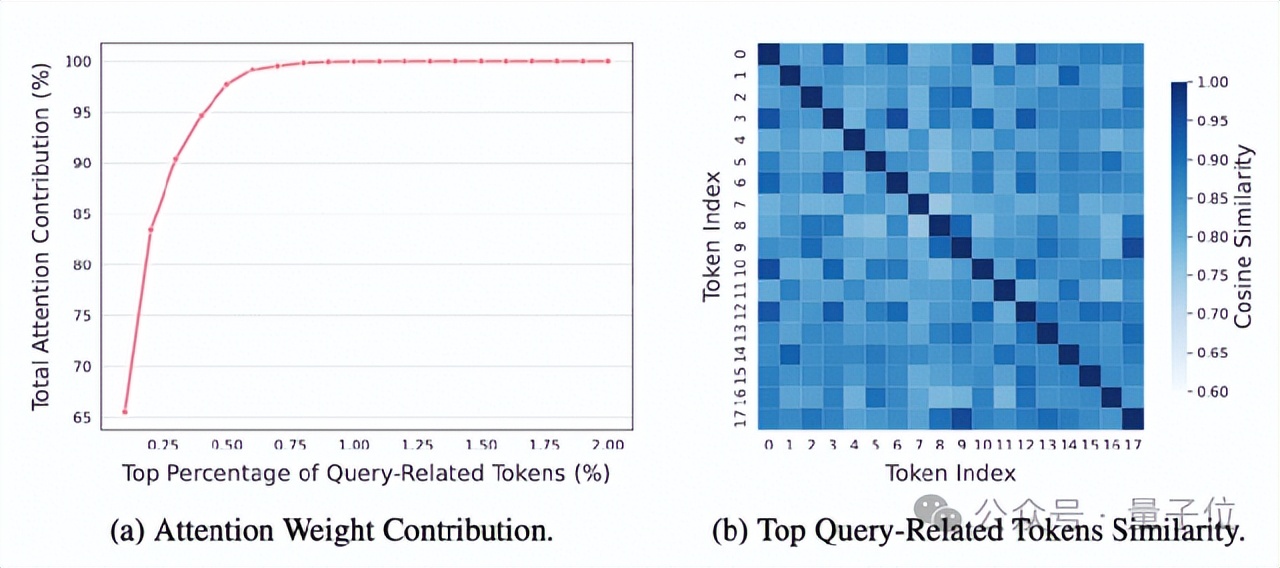

阿里巴巴未来生活实验室的研究团队发现,这一现象的根本原因在于压缩目标的偏差:现有方法过于关注“相关性”而忽视了“多样性”。当多个高度相似的内容被保留时,并不能有效增加信息量,反而会相互干扰(相关并不等同于正确),使模型在面对冗余信息时迷失方向。

为了克服这一挑战,研究团队提出了一种新的观点:高质量的压缩需要同时优化与查询的相关性和信息单元之间的多样性。基于此理念,他们开发了创新框架COMI(COarse-to-fine context compression via Marginal Information Gain),通过边际信息增益指标和粗到细的压缩策略,在32倍高压缩率下仍能精准保留多样化的关键证据链,并已被ICLR 2026接受。

边际信息增益:作为智能标尺

研究团队发现,现有的压缩方法存在缺陷:过度依赖相关性导致冗余堆积,而忽视了token间语义相似性引发的“信息内卷”。为解决这一问题,他们引入边际信息增益(MIG)指标,将压缩决策从单一的相关性转变为多维度权衡:

MIG = 本单元与查询的相关性 - 其他单元的最大相似度

这个指标如同为每个token提供了一个“信息价值评分表”,不仅奖励那些高度相关的片段,还惩罚那些与其他已选内容重复较高的片段。

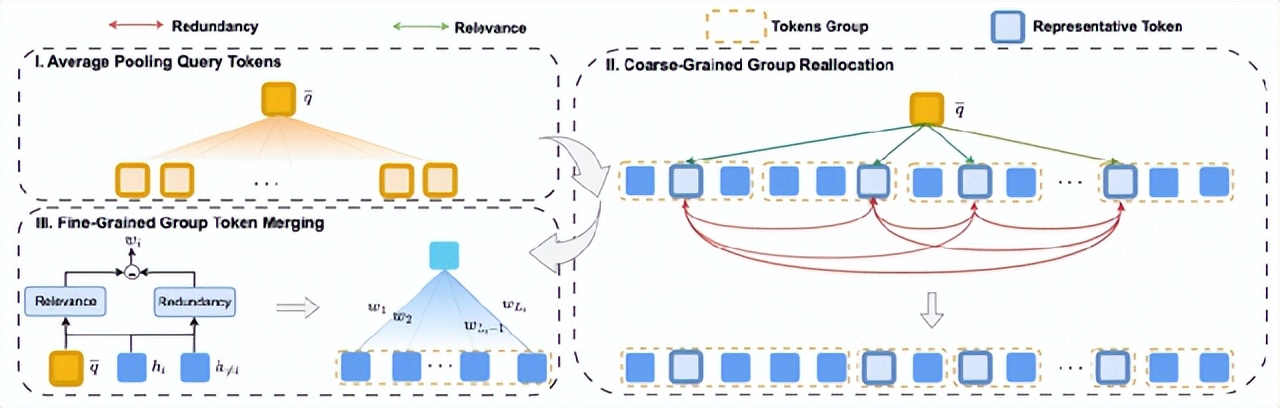

粗到细自适应压缩:让每比特都物有所值

第一阶段:粗粒度组重分配——动态调整“压缩预算”

将长文本分割成等长片段后,COMI不再采取一刀切的方式进行均匀压缩,而是基于组间MIG指标动态调整各段的压缩率。信息密度高、冗余度低的部分(如包含关键证据的段落)将获得更宽松的压缩限制;而信息稀疏或高度重复的区域则会被大幅压缩。这种自适应分配确保有限的压缩预算能够精准投向“高价值信息区”。

第二阶段:细粒度token融合——加权融合避免“信息稀释”

在每个片段内部,COMI根据token级别的MIG指标进行加权融合:高MIG token(相关且独特)在融合过程中占主导权重;低MIG token(冗余重复)则会被自然淡化。这一机制有效防止了传统平均池化导致的“关键细节被平滑”的问题,使压缩后的表示既紧凑又富含多样化的信息。

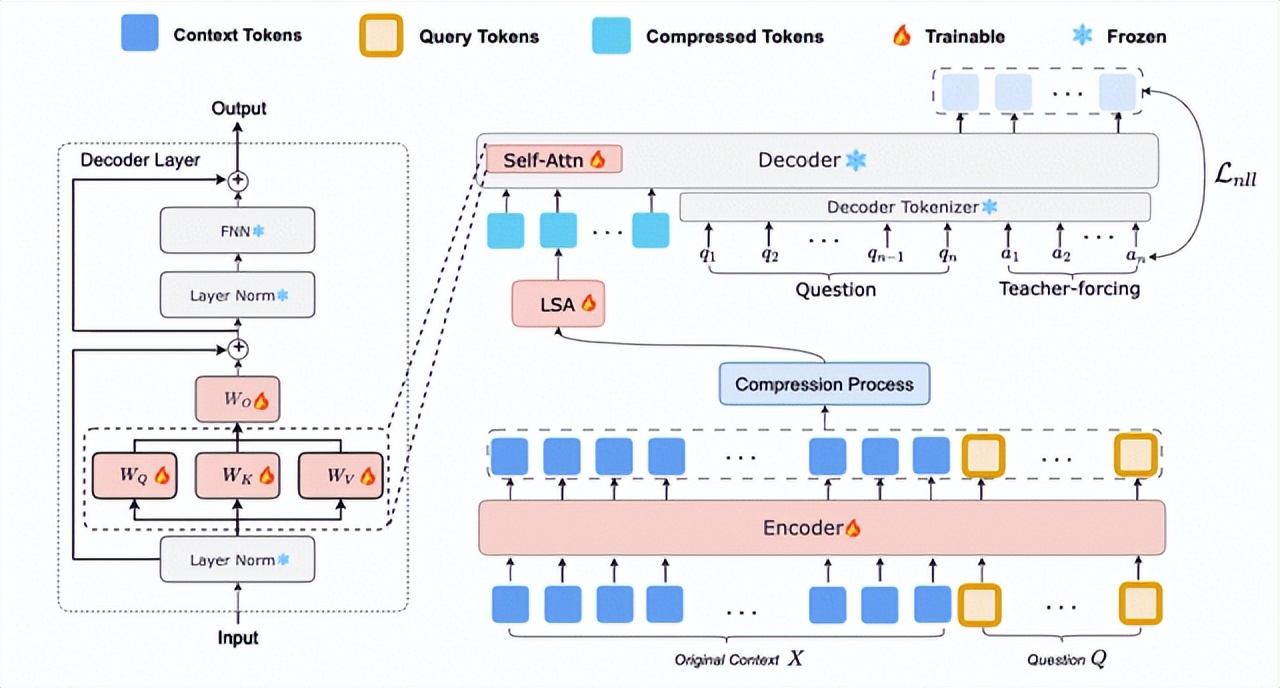

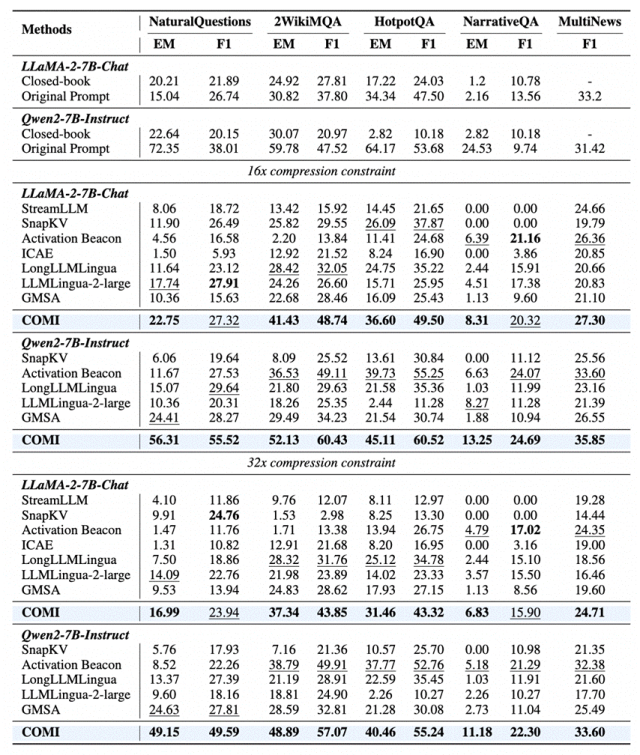

整个框架只需一次训练即可在NaturalQuestions、HotpotQA等五个数据集上执行问答和摘要等多种长上下文任务。

实践验证:高压缩率下的优越性能与深刻洞见

在32倍压缩条件下,以Qwen2-7B为基座模型,在NaturalQuestions上的精确匹配(EM)得分达到49.15,比次优基准高出近25个百分点。即使在面对32K长度的超长文档时(如NarrativeQA),COMI仍能稳定保留推理链的关键节点,证明其在极端压缩场景下的鲁棒性。

压缩不仅是“删减”,更是“提纯”

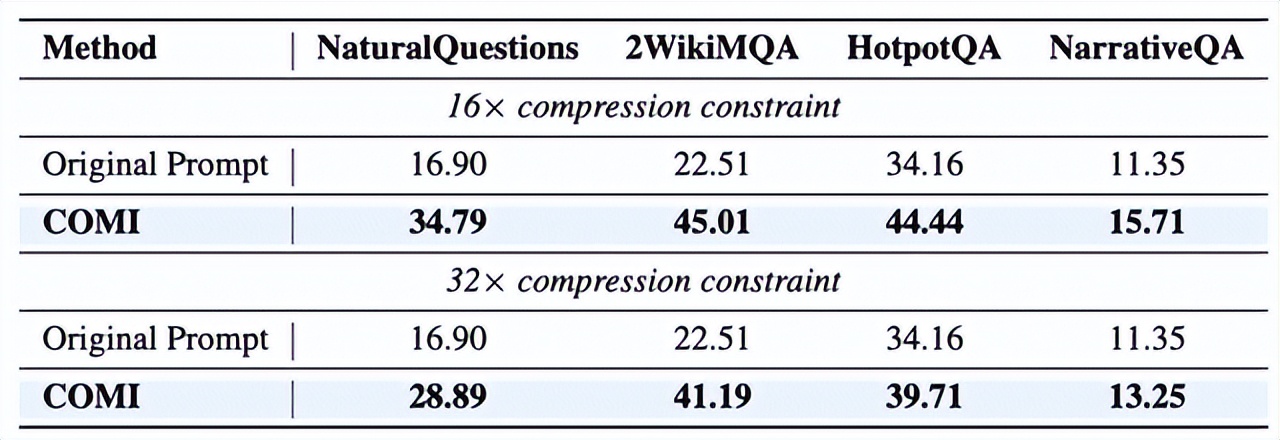

COMI甚至可以提升原生支持256K上下文的Qwen3-4B模型性能。在NaturalQuestions上,经过32倍压缩后,COMI达到了28.89的F1得分,远超直接输入完整文档的16.90。这表明高质量的压缩不仅是“减负”,更是通过消除冗余干扰实现信息提纯,使模型更加专注于核心证据。

下游任务表现卓越

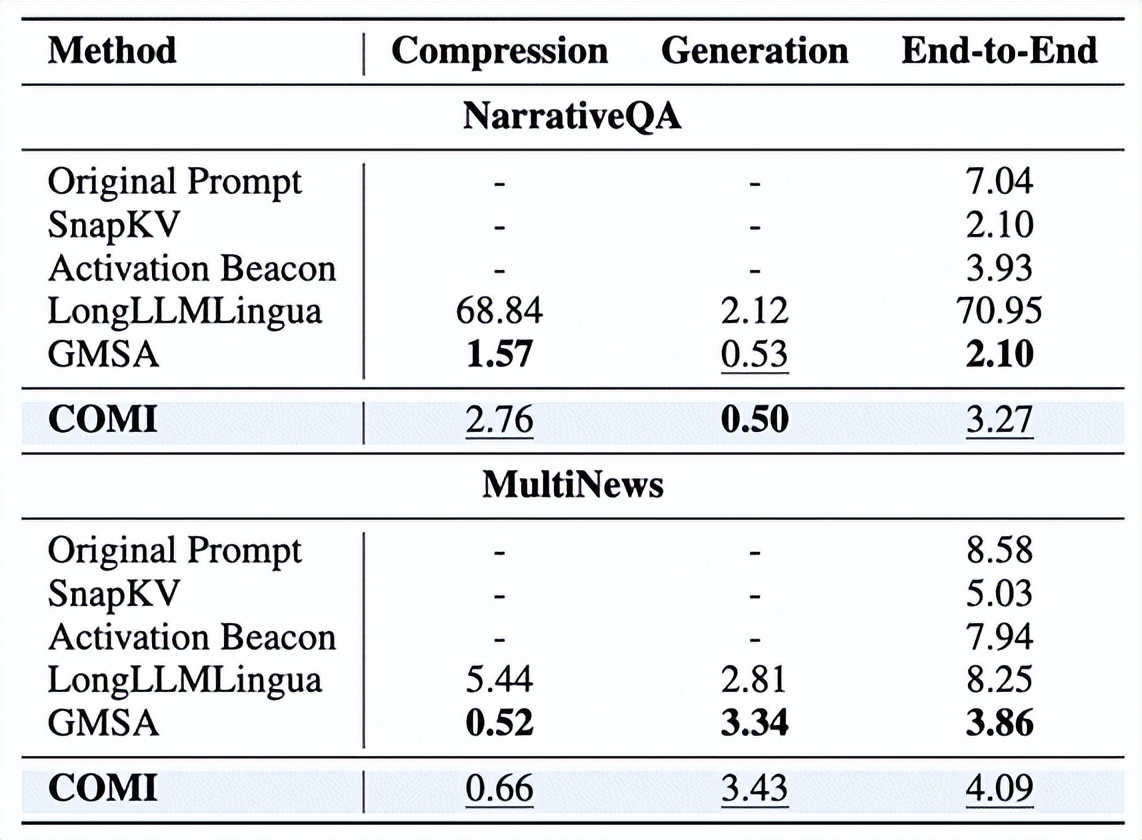

在32倍压缩条件下,COMI实现了端到端推理速度两倍以上的提升,并且在压缩阶段仅引入了轻量级的成本(NarrativeQA任务中压缩耗时为2.76秒,生成耗时仅为0.50秒),为工业级部署铺平道路。

COMI工作开创了一种新的长上下文高效推理范式:

它通过边际信息增益这一简洁而深刻的指标,将压缩目标从“保留相关片段”升级到“保留相关且多样化的信息”,从根本上破解了高压缩率下的性能瓶颈。同时,粗到细的自适应策略确保了整个过程中既符合全局的信息分布规律又保留局部的语义细节。

效率与效果兼得

这项研究证明,真正的高质量压缩并非简单的删减——而是让每一比特都承载多样化的信息价值,为大模型走向轻量化和实用化迈出了关键一步。

总结

COMI工作为长上下文高效推理提供了新范式:

它通过边际信息增益这一简洁而深刻的指标,将压缩目标从“保留相关片段”升级为“保留相关且多样化的信息”,从根本上破解了高压缩率下的性能瓶颈。粗到细的自适应策略则确保了压缩过程既符合全局信息分布,又保留局部语义细节。

这项研究证明,真正的高质量压缩不是简单的“删减”——让每一比特都承载多样化的信息价值,为大模型走向轻量化、实用化迈出关键一步。

论文标题:

COMI: Coarse-to-fine Context Compression via Marginal Information Gain

论文链接:

https://arxiv.org/abs/2602.01719

代码链接:

https://github.com/Twilightaaa/COMI