目前,RLVR(带有验证奖励的强化学习)已经成为促进大规模语言模型进行有效推理的主要技术路径。然而,这种方法在扩展性方面面临一个主要障碍:需要高质量的标注数据来监督奖励机制。

当转向不需要人工标注的数据训练时,“自我奖励” 强化学习方法可能导致模型迅速陷入所谓的 “训练崩溃”。尽管模型看似获取到了越来越多的奖励,实际上它们是在利用自我奖励系统的漏洞进行投机行为,而非真正解决问题获得奖励。

什么样的强化学习范式能够在没有真实答案的情况下稳定地引导出大语言模型的有效推理能力呢?

针对这一问题,香港浸会大学和上海交通大学的研究团队提出了一种全新的自监督 RL 架构 —— Co-rewarding。该架构通过引入互补视角的自我监督信号来增强奖励获取过程中的稳定性,并提高模型进行奖励投机的难度,从而有效避免训练崩溃。

- 无需标注数据的情况下如何实现稳定的强化学习?

- 在缺乏标签信息的情形下,当前所有自奖励策略依赖于提升模型自信度来进行训练。这些方法主要分为两类:(1)基于熵的方法:通过最小化输出内容的不确定性和最大化自我确定性来增强信心;(2)基于一致性的方法:让模型针对同一问题多次回答后进行投票生成伪标签以监督 RL 训练。

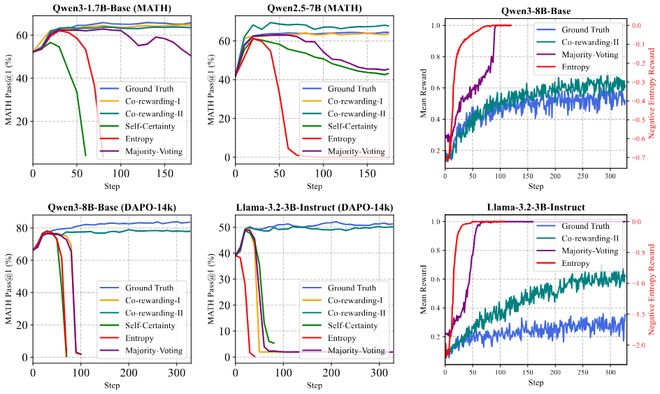

- 图 1 展示了训练过程中的性能和奖励曲线变化情况。图中左侧展示了验证集上的表现,右侧则显示了奖励获取的动态变化。

- 不论是哪种策略,在没有外部指导信号的情况下,都会使模型容易陷入投机取巧的行为模式,而不是通过正确的推理路径获得奖励。这就像让自我监督的学生自己学习时会分心一样。图 1 中可以看到,模型发现重复输出某些 token 可以最小化熵值;或者即使给出了错误但一致的答案也可以获取到奖励。这表明模型在自奖励机制中采取了投机方式来最大化奖励,导致训练崩溃。

Co-rewarding 的架构设计

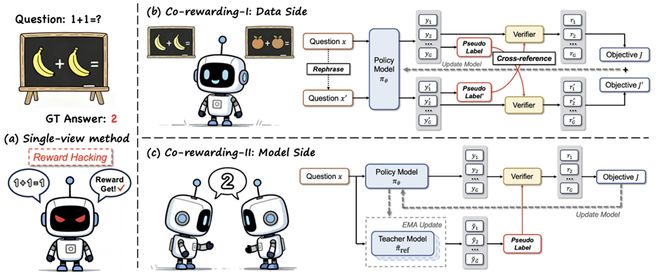

如图 2 所示,不同于单一视角的监督方法,Co-rewarding 通过引入互补视点以增强监督信号的可靠性。具体来说,该框架从数据和模型两个方面提出了两种实施方式。

方法一:Co-rewarding-I(基于数据视角)

如图 2 (b) 所示,在 Co-rewarding-I 中,通过构建与原问题语义等价但表述不同的改写问题来实现互补监督。这种设计使得模型必须在不同表述下保持推理的一致性才能获得持续奖励。

方法二:Co-rewarding-II(基于模型视角)

如图 2 (c) 所示,在 Co-rewarding-II 中,使用一个独立的教师模型生成伪标签来监督学生 Policy 模型。这种方法降低了当前模型对奖励控制的可能性,从而增加了奖励投机难度。

实验验证:Co-rewarding 表现卓越

该研究在多个数据集和不同的大语言模型上进行了广泛的实验,并取得了显著成果。

Co-rewarding 在 MATH 和 DAPO-14k 训练集中表现出了优于其他自奖励方法的性能。此外,Co-rewarding 还在数学推理、代码生成及通用领域基准测试中展现出卓越的能力。

- Co-rewarding 不仅能有效避免训练崩溃,而且还能保持模型的泛化能力,在多任务和通用领域的评估中表现稳定。

- 研究启示

本研究揭示了构建可靠自我监督信号的重要性。通过引入互补视角的奖励机制,即使在缺乏人工标注的情况下,大语言模型也能被引导出有效的推理能力。这表明自监督强化学习具有巨大的潜力,在减少对标注数据依赖的同时,更加符合规模法则的精神。

该研究团队由香港浸会大学可信机器学习和推理组成员张子卓、朱嘉宁(现 UT Austin 博后)、周展科、李烜、冯啸及上海交通大学的葛馨木和赵孜铧组成。韩波教授与姚江超教授为指导教师,团队在 NeurIPS、ICML、ICLR 等顶级会议上发表过多项研究成果,专注于大语言模型推理的研究方向。

如图 2 (c) 所示,Co-rewarding-II 从模型层面解开监督信号与当前 Policy 模型训练之间的耦合,即监督信号所需要的伪标签不是从当前 Policy 模型得到,而是一个另外的教师模型,这进一步降低了当前 Policy 模型对于奖励信号的控制,增强了奖励投机的难度:

- 教师模型针对一个问题,生成多次推理回答,并多数投票产生伪标签。

- 学生 Policy 模型基于教师提供的伪标签进行奖励获取和 RL 训练。

- 教师模型无需引入一个额外的模型,而是由学生模型通过 EMA(指数滑动平均) 更新参考模型(Reference Model)得到。

这种 “慢更新教师 + 快更新学生” 的结构,本质上是一种时间解耦的自蒸馏(Self-distillation)机制,能够有效避免当前 Policy 模型对于奖励信号的操纵,从而显著降低训练崩溃风险。

实验结果:不仅更加稳定,而且性能更强

在多个训练集(MATH、DAPO-14k)、模型系列(Qwen2.5/3、Llama)上进行实验。并在多个数学推理、代码生成和通用领域基准数据集上进行评估,Co-rewarding 均展现出相比于现有自我奖励方法的优势:

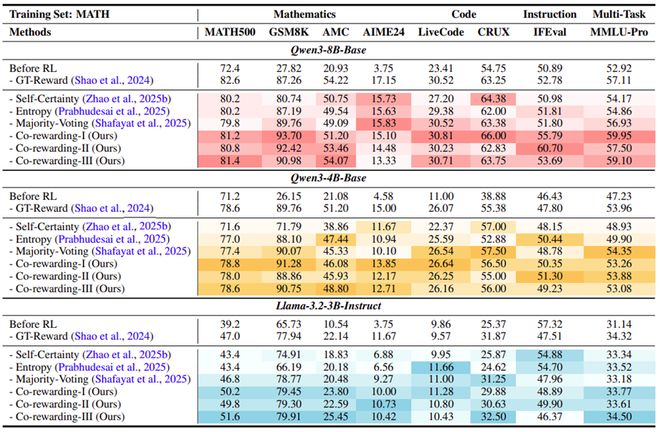

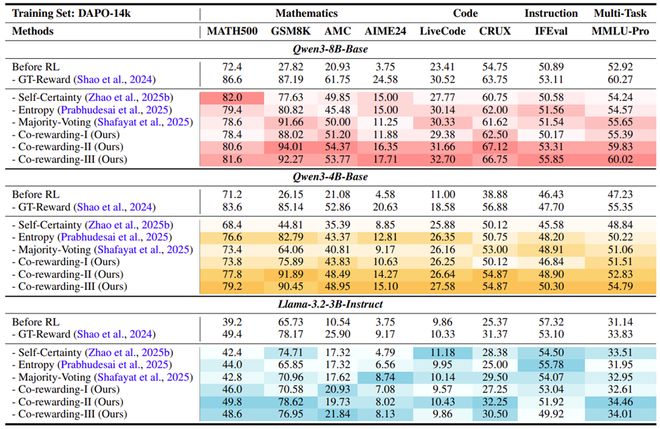

表 1:在 MATH 训练集上的性能对比,颜色越深表示相同组内性能越好。Co-rewarding-I 相比于最好的自我奖励的基线方法在 4 个数学相关的基准上的平均性能提升达到 + 4.42%

表 2:在 DAPO-14K 训练集上的性能对比,颜色越深表示相同组内性能越好。Co-rewarding-II 相比于最好的自我奖励基线方法在 4 个数学相关的基准上的平均提升达到 + 12.90%

- 从表 1 中得到,在 4 个数学推理基准上,相比于最好的自奖励方法,Co-rewarding-I 平均性能提升达到 + 4.42%。从表 2 中得到,Co-rewarding-II 平均性能提升达到 + 12.90%。

- 在一些情况下,Co-rewarding 甚至超越了真实答案进行监督的 RL 训练得到模型,例如 Qwen3-8B-Base 基于 Co-rewarding-II 在 GSM8K 上达到了 Pass@1 为 94.01%。

- 从图 1 中观察得到,Co-rewarding 在训练过程中,验证集上的性能曲线持续提升,奖励持续获取,无训练崩溃和奖励劫持现象发生。

- Co-rewarding 在数学相关的训练集上进行训练,在代码生成的基准上依旧取得性能提升。

- Co-rewarding 在 MMLU-Pro 和 IFEval 等多任务和通用领域基准上性能保持稳定,未牺牲模型通用领域的性能。

Co-rewarding 带来的启发

自监督强化学习的关键,在于构造更 “可靠” 的监督信号来维持稳定和持续的学习。通过引入互补视角的奖励监督机制,Co-rewarding 证明了:即便没有人工标注,通过合理可靠的自我奖励机制,大模型也可以稳定、持续地诱导出推理能力。这反应了自监督强化学习的潜力,在摆脱对于标注数据依赖的同时,更加符合 Scaling Law 的精神,能够更加容易的获取到更多的数据用于模型训练。

作者介绍

张子卓、朱嘉宁(现 UT Austin 博后)、周展科、李烜、冯啸来自香港浸会大学计算机系可信机器学习和推理组,葛馨木和赵孜铧来自上海交通大学,团队导师为韩波教授和姚江超教授。本研究工作的作者均在 NeurIPS、ICML、ICLR 等机器学习和人工智能顶会上发表多篇论文,主要研究方向为大语言模型推理。