新智元报道

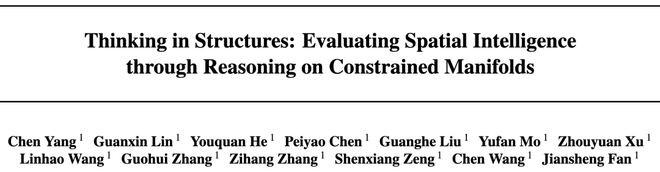

SSI-Bench是首个专注于评估模型在约束流形中空间推理能力的基准,强调真实结构和具体限制条件,通过排序任务来考察模型对三维几何与拓扑关系的理解程度,揭示了当前大模型在处理实际空间问题时严重依赖二维信息的情况,并且其表现远逊于人类。

如果将一个在空间理解榜单中得分很高的多模态大型模型直接放置于现实世界环境中,它很可能会在看似简单的任务上遇到困难。

这并不是因为该模型无法「观察」,而是因为它从未被迫真正尊重三维结构的实际可行性——它可以依赖二维相关性、外观预设以及数据集中的特定模式来取得高分。

实际上,在许多空间问题中,解决方案往往受限于几何学、拓扑和物理法则所构成的复杂约束条件,而不是随意形成的。

清华大学的研究团队为此开发了SSI-Bench,从AI与结构工程交叉领域的视角出发,提供了一种新的评估框架——在复杂三维结构的受限制环境中检验多模态大模型的空间智能表现。

SSI-Bench将这种能力定义为Constrained-Manifold Spatial Reasoning(CMSR),即在一个受到明确约束条件限定的空间中进行推理。

在这类任务中,潜在的三维状态并非可以随意假设,而是必须满足特定的等式和不等式约束条件,并且这些约束条件会显著缩小可行解的空间范围,使得空间关系在不同解释下的稳定性得到提升,从而使评测结果更具可量化性和可比性。

SSI-Bench的设计不再将模型置于宽松的日常场景中测试,而是要求它们在复杂的真实工程结构环境中形成一致的三维假设,并在此基础上完成推理任务。

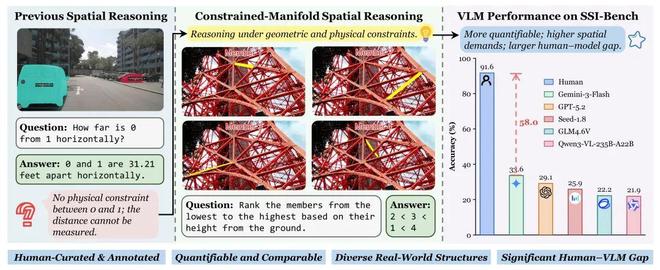

该评估使用排序题的形式来检验模型的能力:每道题目提供三或四个候选「组件/组件组」,并需要根据指定的几何和拓扑准则输出正确的全排列顺序。

测试覆盖了几何、拓扑以及多视角一致性三大类任务。整个测试包含一千个排序问题,分为两大类:

几何类(Geometric):涉及地面高度、角度、维度、相对距离、面积和体积;

拓扑类(Topological):包括跳步距离和循环长度等图结构关系;

此外,还加入了跨视角题目来考察模型在不同视点下的构件对应能力和整体结构一致性。

聚焦复杂三维结构

纯人工硬核打造

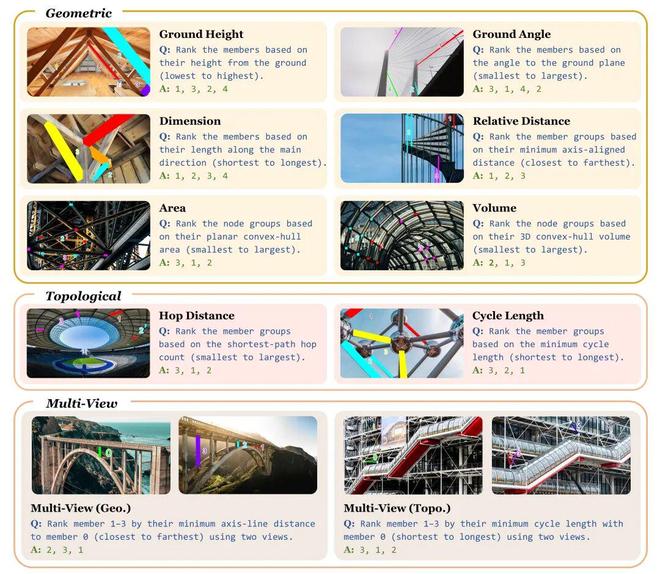

为了确保数据集的高质量与多样性,SSI-Bench由十位研究人员耗时超过四百小时人工筛选和设计而成:

数据收集阶段审查了大约两万张相关图片,涵盖了空间网架、铁塔、斜拉桥等多种结构形式,并保留了两千多个候选样本;

任务设计环节根据空间智能需求与工程专业知识精心规划了两大类十小类的任务。

元数据标注过程包括判断每幅图适用的任务类型,使用Label Studio进行构件定位标记;

- 问题生成阶段依据图片色彩自动选取标注颜色,并按位置布局文本;

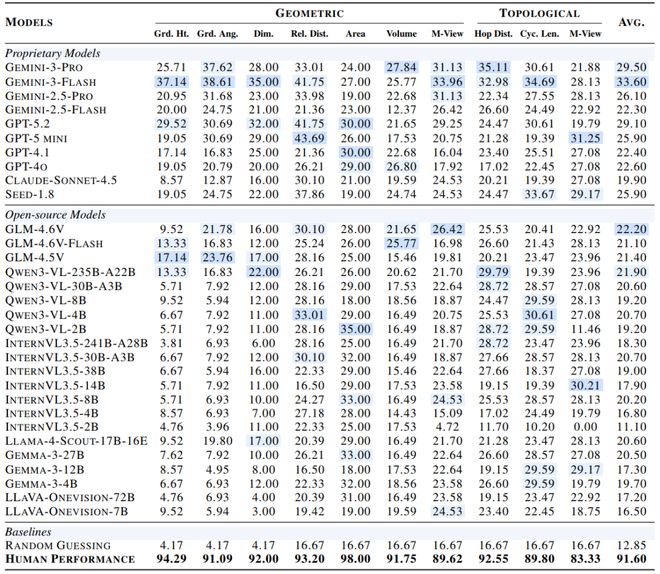

- SSI-Bench对31种主流视觉语言模型进行了系统评估,结果显示人类表现几乎碾压式领先:平均准确率为91.6%,最强闭源模型为33.6%(Gemini-3-Flash),开源模型最佳表现为22.2%(GLM-4.6V),随机猜测的基线分数则为12.85%。

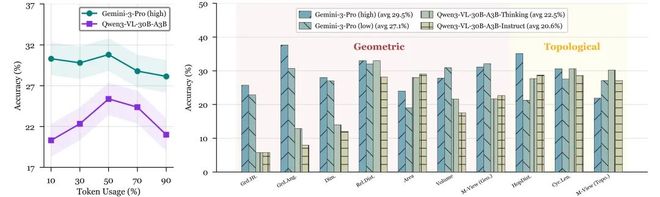

并且即使鼓励模型生成更复杂的推理过程,整体性能提升也多局限于边际层面,并无法克服核心瓶颈。对于需要全局三维一致性的情况(如多视角和体积计算),过多的推理反而可能在错误假设上不断累积偏差。

论文通过对典型模型的人工复盘分析,总结了四类常见错误类型:

构件范围误判:局部观察导致整体判断失误;

- 构件/节点识别错误:混淆不同部件并发生方向判断失准;

- 3D空间逻辑错误:深度关系混乱、跨视角对应失败以及结构一致性问题。

- SSI-Bench的意义不仅在于创建一个更难的问题集,而是在于将空间智能评估拉回到更加接近现实世界的坐标系中:当面对复杂真实结构、强约束条件以及二维捷径不再可靠时,模型是否能够稳定地构建出约束一致的三维假设并完成推理?

- 同样也正因为如此,SSI-Bench为研究指明了一个明确的方向:让空间智能体从「会看图说话」过渡到「能在结构中思考」。

- Yang, C. et al. (2026). Thinking in structures: Evaluating spatial intelligence through reasoning on constrained manifolds. arXiv. https://arxiv.org/abs/2602.07864

模型仍在起跑线

人类领先近六成

SSI-Bench系统评测了31个主流VLM,结论非常直接:人类几乎「碾压式领先」。

人类平均91.6%,最强闭源33.6%(Gemini-3-Flash),最强开源22.2%(GLM-4.6V),随机猜测基线12.85%

也就是说,哪怕拿到当下最强大模型,人类仍然领先58个百分点(91.6 − 33.6)。

更为关键的是,即使鼓励模型生成更长的推理过程,整体提升也多停留在边际层面,难以触及问题的核心瓶颈。并且在部分高度依赖全局三维一致性的任务(如Multi-View、Volume)中,过度推理反而可能在错误的结构假设上持续累积偏差,使结果进一步偏离正确答案。

从结果到机制

关键瓶颈在哪里?

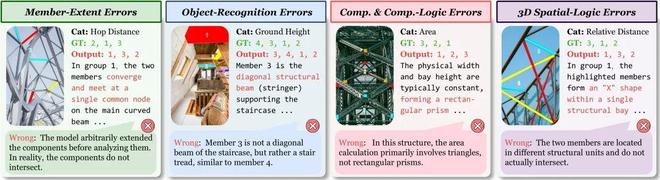

论文对代表模型做了人工复盘,归纳出四类高频错误:

构件范围误判:仅观察到局部便误认为整体,或对端点位置产生错误「补全」;遮挡越多,问题越突出。

构件/节点识别错误:混淆不同部件,方向判断失准(例如将倾斜构件误判为水平或垂直)。

计算与比较逻辑错误:在Area/Volume等任务中计算方式错误(例如以2D投影替代3D体积),或采用不成立的简化假设。

3D空间逻辑错误:深度关系混乱、跨视角对应失败、关系组合不稳定,进而导致整体结构假设不一致。

这也解释了SSI-Bench的「硬核」并不在于题目刻意刁钻,而在于它迫使模型直面并补齐两项关键短板:三维结构构型识别与约束一致的空间推理。

结语

SSI-Bench的价值,并不是再造一个「更难的VQA」,而是把空间智能评估拉回一个更接近现实的坐标系:

当场景是复杂真实结构、当可行解被强约束收缩、当2D捷径不再可靠——模型是否还能稳定地构建约束一致的3D结构假设并完成推理?

从目前结果看,答案仍然很残酷:模型还在起跑线,人类已在终点线附近。

但也正因如此,SSI-Bench给出了一个非常明确的研究方向:

让空间智能体从「会看图说话」,走向「会在结构里思考」。

参考资料:

https://ssi-bench.github.io/

Yang, C. (杨晨), Lin, G., He, Y., Chen, P., Liu, G., Mo, Y., Xu, Z., Wang, L., Zhang, G., Zhang, Z., Zeng, S., Wang, C. (王琛), & Fan, J. (樊健生) (2026). Thinking in structures: Evaluating spatial intelligence through reasoning on constrained manifolds. arXiv. https://arxiv.org/abs/2602.07864.