近日,国内领先的AI云计算服务提供商阿里云推出了一系列重要更新。

一哥就有一哥样。

刚刚复工之际,阿里云一口气发布了Qwen3.5、GLM-5、MiniMax M2.5和Kimi K2.5四款顶尖开源模型。

这些新上线的模型无疑具有重要意义:

Qwen3.5作为阿里自主研发的新一代旗舰级大模型,在算力消耗极低的情况下,其性能已超越当前多个顶级闭源模型,并在Hugging Face榜单上占据榜首位置。

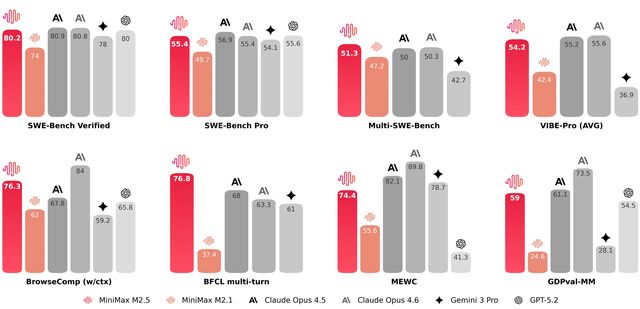

MiniMax M2.5则专注于代理(Agent)场景应用,具备处理复杂办公任务的强大能力。自发布以来,MiniMax的股价也因此有所提升。

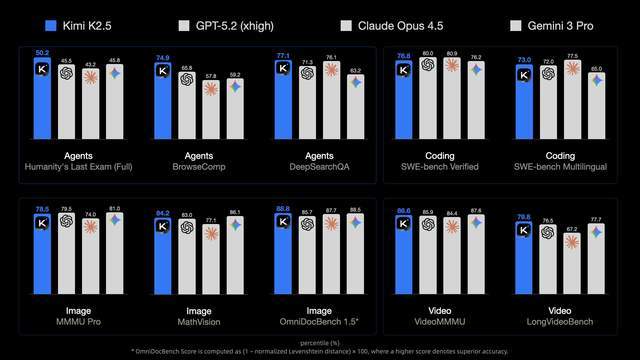

Kimi K2.5以多模态和编程领域的卓越表现著称,在上线短短二十天内就取得了不俗的成绩。

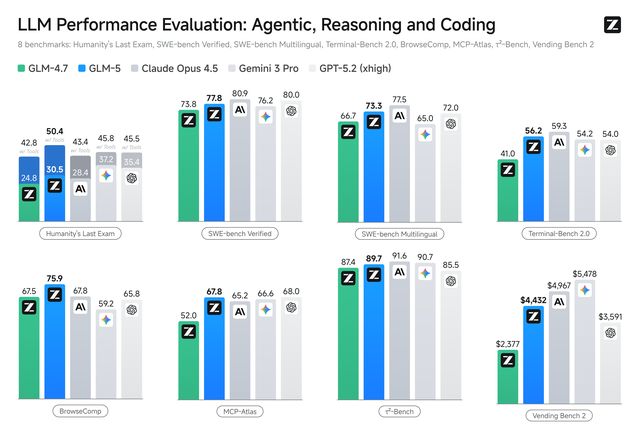

GLM-5则因其在长任务中的出色表现以及与Claude Opus 4.5相媲美的编程能力而备受瞩目。发布前即引发广泛关注,热度持续攀升。

阿里云迅速整合了这些炙手可热的模型,并为开发者们提供了丰富的API接口和订阅服务选项。

新推出的Coding Plan订阅服务以极低的价格提供大量Token额度,新用户首月只需7.9元即可享受无缝切换各种顶级编程模型的便利。

在这次春节大模型更新浪潮中,阿里云无疑成为最大的赢家之一。其诚意和开放性也获得了众多开发者的青睐。

这四款顶尖开源模型被选中的原因在于它们各自在性能、功能及应用场景上都有着突出的优势。

例如,Kimi K2.5作为K2系列的升级版,在多模态理解与代码生成方面表现出色。用户只需上传一张截图,就能自动生成带有动态效果的前端代码,并支持局部图更新等高级操作。

这性价比杠杠的。

MiniMax M2.5则是在代理场景中表现出众,通过更少对话轮次实现高效任务处理,同时具备深度学习专业知识的能力,能够生成高质量的专业文档和报告。

四大模型齐聚一堂

GLM-5在编程基准测试中取得了优异成绩,并且能够在复杂的逻辑推理任务中提供准确的答案。内置思考模式开关进一步减少了逻辑幻觉的发生几率。

最后发布的Qwen3.5不仅性能卓越,在算力利用效率上更是遥遥领先于其他同类模型,成为近期最受开发者欢迎的开源大模型之一。

这些顶尖模型齐聚阿里云平台,为开发者的自由选择提供了无限可能。尤其是对于那些在春节期间忙于事务而未能及时跟进行业动态的技术人员而言,现在可以一站式获取所有最新资源。

阿里云此次升级推出Coding Plan订阅服务,不仅提供大量Token额度,还大幅降低了用户的使用成本。

具体来说,Lite基础套餐每月最多支持18000次请求,新用户首月只需支付7.9元;高级版Pro套餐则可享受更多资源和服务,价格同样非常亲民,仅为39.9元。

目前阿里云Coding Plan共支持八款顶尖编程模型,并实现了统一计费与额度共享机制,为用户提供更灵活的选择空间。

除了Coding Plan外,阿里云百炼平台也迎来了持续增强。现在开发者只需通过一个入口即可接入百余款国内外主流模型API,根据业务需求自由选择使用场景。

此外还提供了大量AI硬件、短视频及广告内容等领域内的Agent模板与服务,企业无需从零开发,按需调用即可实现快速部署和应用。

图片来自月之暗面

这种一站式的解决方案极大地简化了开发流程,并且能够帮助开发者们完成从需求分析到最终监控追踪的一整套闭环工程化过程。

四大顶流模型齐聚阿里云平台,这在行业内实属罕见。其他云服务商要么只推广自家产品,要么零散接入少数第三方模型,而阿里云则采取了更为开放的态度。

这种做法背后的原因在于阿里云本身具备强大的技术实力和完善的用户生态系统,能够为这些优质大模型提供良好的发展环境。

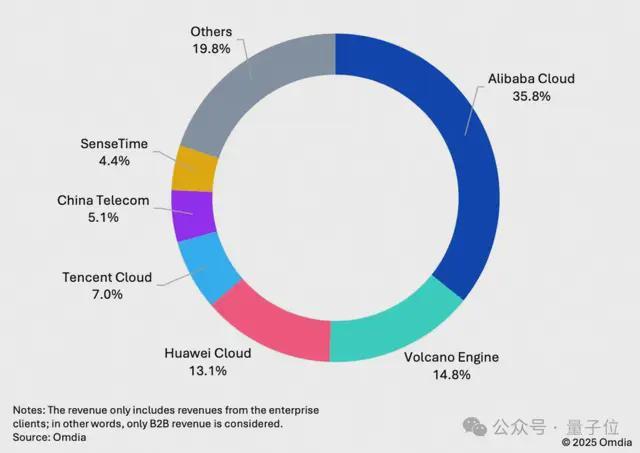

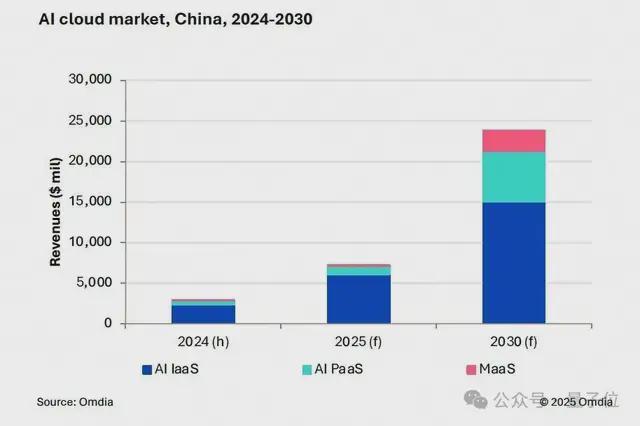

作为亚太地区领先的云计算服务商,阿里云的成功离不开其在技术与商业模式上的双重突破。一方面拥有超大规模的智算集群和软硬协同加速推理的能力;另一方面在国内率先提出了MaaS概念,并打造了一站式开发平台。

此外,成熟的用户生态体系也为模型厂商提供了直接接触最迫切需求群体的机会。

此外,成熟的用户生态体系也为模型厂商提供了直接接触最迫切需求群体的机会。

加入阿里云意味着能够直接对接阿里巴巴背后的庞大企业客户群,海量场景生态为大模型的发展提供了最好的练兵场。

因此,阿里云构建起了“算力-集成-生态”三位一体的飞轮效应,从而吸引了众多优质的大模型加入其平台。

对于阿里自身而言,选择开放的战略逻辑是贯穿从大模型到云服务始终如一的核心理念。阿里巴巴深知,在AI时代里没有哪家公司能够垄断所有模型资源。

与其将第三方视为竞争者,不如将其视作共同发展的合作伙伴,携手推动整个行业的进步与发展。

总而言之,阿里云凭借其开放的态度和强大的平台优势,在新的一年中继续引领着云计算服务的发展潮流。

图片来自智谱

最后是除夕压轴登场的Qwen3.5,也是阿里最新一代旗舰级大模型。

作为Qwen家族新成员,在延续以往开源优势的同时,实现了极低算力消耗下,性能全面对标GPT-5.2和Gemini-3-Pro。

而且总参数只有3970亿,激活仅需170亿,性能却比万亿参数的Qwen3-Max还要强。更直观的是,部署显存占用降低60%,最大推理吞吐量提升19倍,达成大模型效率和成本双双优化。

百万Tokens低至8毛,相当于Gemini-3-pro的1/18。

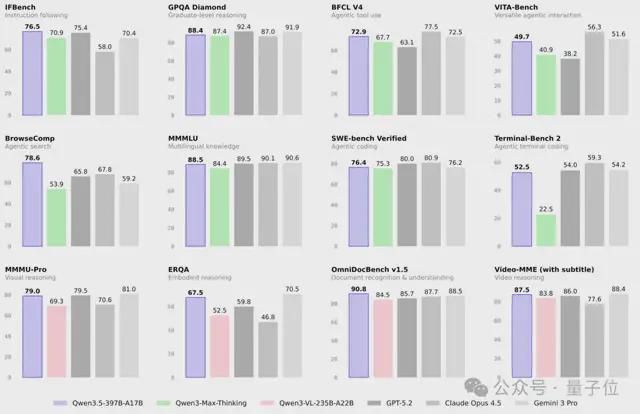

再具体看基准测试结果。在推理、编程、智能体等核心维度上,Qwen3.5再创新高。

例如,在考核综合认知能力的MMLU-Pro测试中,千问3.5得分87.8分,超过GPT-5.2;在博士级难度的GPQA上斩获88.4分,比以严谨逻辑著称的Claude 4.5还要高;在Agent能力上也是全面发力,BFCL-V4和Browsecomp评分均全面超越Gemini-3-Pro。

能力强、价格低、还开源,也难怪Qwen3.5一出,就成为近期最受开发者欢迎的开源大模型。

而上述这些各有所长的顶级模型们,现在齐刷刷聚集阿里云,也是给予开发者自由选择的便利。

尤其是那些过年期间忙着干饭,还没来及追行业动态的开发者们,现在阿里云直接能一站式购齐了。(doge)

价格造福开发者

既然是开工福利,阿里云也给咱们把价格打下来了。

众所周知,OpenClaw这类Agent工具是Token“黑洞”。为了让Agent深度理解,必须反复读取整个项目内容,而每多一轮对话,上下文就会呈指数级堆叠。

Agent在写代码时往往也是比较盲目的,经常需要反复报错修改,这就导致Token消耗极快。

而阿里云专门为此推出的Coding Plan,能够让模型按需使用Token,有效减低使用成本。

具体来说,阿里云Coding Plan在本次升级中,走的是加量不加价路线。Lite基础套餐每月可最多18000次请求,新用户首月购买仅需7.9元,比2折还低。

高级版Pro套餐,每月更是可狂揽90000次请求,上千次复杂任务都不在话下,非常适合企业级用户。价格方面,首月也同样低至39.9元,一杯全家福奶茶的价格。

至此,加上新增的四款模型,阿里云Coding Plan目前共支持8款顶尖编程模型,包括阿里自研的Qwen3.5-Plus、Qwen3-Max、Qwen3-Coder-Next、Qwen3-Coder-Plus,以及第三方的GLM-5、GLM-4.7、Kimi-K2.5、MiniMax-M2.5。

所有模型统一计费、额度共享,订阅后均可实现自由切换。

妥妥的国内AI云服务最强组件。

不止Coding Plan,其所在的阿里云百炼平台也迎来持续增强,全家桶式接入了百余款国内外主流模型API。

企业无需分别对接几十家公司的API,只需百炼一个入口,就能根据业务场景灵活使用,比如财务审计可以用GLM-5,文案创意用Qwen3.5。

还有400多个AI硬件、短视频及广告内容等领域的Agent模板与服务,企业无需再从零开发,而是按需调用,工程应用时间缩至最短。

它为开发者们提供了一整套“需求分析→编程开发→逻辑测试→部署运维→监控追踪”的开发链路,实现了低门槛的闭环工程化跨越。

为什么是阿里云?

其实四大顶流模型同框齐聚阿里云这事,真挺活久见的。

其它云厂商要么只推自家模型,要么零散接入少数第三方,像阿里云这番海纳百川,也是业内头一份了。

而且这四款个顶个的都是广受好评的开源旗舰款,刚落地就被阿里云带走,归根结底还是阿里云自身实力够硬,强强联合,实现1+1>2。

作为亚太第一的云厂商,阿里云能做到这点,离不开技术与商业的双重突破。

首先阿里云拥有超大规模的智算集群,能提供万卡级别的并行训练算力。对于第三方模型,阿里云不仅能提供稳定的GPU资源,还可通过软硬协同加速推理过程,从而降低模型部署的运维成本。

阿里云也是国内最早提出模型即服务(MaaS)概念的。打造的一站式开发平台阿里云百炼提供了开发包容的集成环境,也便于模型厂商直接接触到最迫切的用户群体。

更关键的一点是,阿里云已经拥有相当成熟的用户生态。长期以来的开源路线让阿里云拥有了一批忠实的付费客户,旗下的魔搭社区更是汇聚了数百万开发者。

与此同时,入驻阿里云也就意味着模型厂商能够直接对接阿里背后的数十万企业级客户,海量的场景生态是大模型最好的练兵场。

自此,阿里云构建起“算力-集成-生态”三位一体的飞轮效应,所以能吸纳来这么多优质的大模型加入,也是情理之中。

而对于阿里自身,选择开放,也是它们长期以来从大模型到云服务一以贯之的战略逻辑。

阿里清晰地认识到,AI时代没有一家公司能垄断全部模型。与其把第三方当作对手,不如将自己作为底层操作系统,承载着全部AI大模型一同起飞。

换言之,从互联网时代到AI时代,阿里的初心从未改变,就是为用户提供最好用的产品。

所以年后复工第一站,选择阿里云看来还真不戳~